Читайте в Telegram

|

OpenAI могут подорвать люди, которые когда-то сами строили эту компанию. Часть бывших сотрудников объединилась и создала конкурента — Anthropic, который уже обогнал компанию Сэма Альтмана по оценке на вторичном рынке. Главный продукт Anthropic — вирусная нейросеть Claude.

Кто смог бросить вызов лидеру ИИ-рынка, как сформировалась эта команда и кто стоит за Claude — разбираемся в этом материале.

Это рубрика досье SpeShu.AI. Здесь мы собираем психологические портреты людей, которые двигают индустрию ИИ вперёд и меняют мир так же, как в своё время это сделали Лейбниц, Эйнштейн и Курчатов.

Claude: краткий разбор

Claude — нейросеть от Anthropic, которую особенно ценят за работу с большими объёмами текста, кодом и задачами, где важно удерживать длинный контекст. Ей можно дать документ, переписку, код или сложную задачу — и получить ответ без ощущения, что модель «забыла» начало на середине.

Особенно заметно Claude проявил себя в разработке. Инструмент Claude Code умеет анализировать кодовую базу, вносить изменения, запускать тесты и доводить задачи до результата.

Реакция индустрии это подтверждает. Глава NVIDIA Дженсен Хуанг называл Claude «невероятным» и отмечал серьёзный прогресс Anthropic в области программирования и рассуждений. По его словам, внутри NVIDIA эту модель используют очень широко.

К апрелю 2026 года Anthropic уже воспринимается как главный конкурент OpenAI. В официальных раундах компания получила оценку около $380 млрд, а на вторичном рынке спрос на акции поднимает неформальную оценку к уровню около $1 трлн.

При этом связь с OpenAI прямая: Anthropic основали бывшие сотрудники компании, включая Дарио и Даниэлу Амодеи. По сути, Claude — это продукт команды из центра ИИ-гонки, которая решила строить альтернативу ChatGPT с упором на безопасность, устойчивость и практическое применение.

Дарио Амодеи — CEO Anthropic

Дарио Амодеи — человек, стоявший у истоков сразу двух ключевых направлений: GPT и Claude. По образованию он физик и биофизик: учился в Стэнфорде, получил PhD в Принстоне, работал в Stanford Medicine и занимался исследованиями нейронных систем.

До Anthropic он работал в Google Brain, а затем стал вице-президентом по исследованиям в OpenAI, где руководил разработкой GPT-2 и GPT-3.

В 2021 году он вместе с сестрой Даниэлой и частью команды OpenAI основал Anthropic. Причина ухода была прагматичной: разошлись взгляды на развитие сильного ИИ. Амодеи делал ставку на управляемость, интерпретируемость и безопасность — этот подход остаётся основой философии компании.

Он редко появляется публично, но его тексты активно обсуждаются в индустрии. В 2024 году он выпустил эссе Machines of Loving Grace — о том, как ИИ может трансформировать медицину, образование и экономику. В 2025 году писал о геополитике ИИ и проблеме интерпретируемости моделей.

Самый громкий эпизод произошёл в феврале 2026 года: Anthropic обсуждала работу с Пентагоном, но отказалась снимать ограничения — запрет на массовую слежку и автономное оружие. Амодеи прямо заявил, что такие системы пока недостаточно надёжны и несут риски для гражданских свобод.

Даниэла Амодеи — президент Anthropic

Даниэла Амодеи — сестра Дарио и человек, который держит компанию в рабочем состоянии. До Anthropic она работала в Stripe, затем в OpenAI, где отвечала за безопасность и политику. После этого вместе с командой основала Anthropic.

В компании она отвечает за операционную часть: команды, процессы, партнёрства, взаимодействие с регуляторами и вывод продукта на рынок.

Если Дарио задаёт научное направление, то Даниэла обеспечивает, чтобы компания масштабировалась и выдерживала давление рынка. Это критично: одной сильной модели недостаточно — нужна инфраструктура, клиенты и стабильные процессы.

Крис Олах — исследователь интерпретируемости

Он бросил университет в 18 лет, получил грант Тиля и пошёл своим путём.

Его карьера прошла через ключевые лаборатории: Google Brain, OpenAI, Anthropic. Без классического академического пути он стал одним из ведущих исследователей.

В Anthropic он занимается интерпретируемостью — пытается понять, что происходит внутри моделей. Его команда анализирует «нейроны» нейросетей, выявляя структуры, отвечающие за смысл, поведение и паттерны.

TIME включил его в список TIME100 AI как одного из пионеров этого направления.

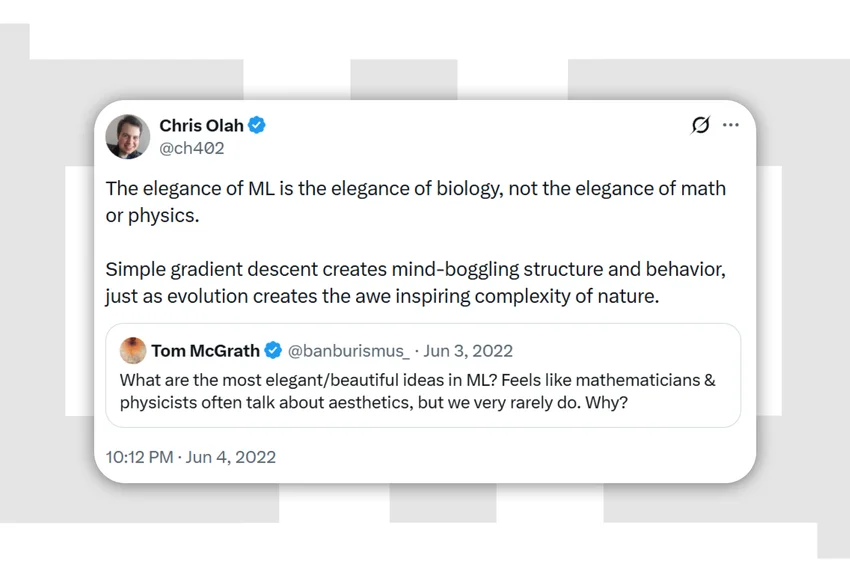

Его подход ближе к биологии, чем к классической инженерии. Он рассматривает нейросети как сложные системы, похожие на живые организмы, а не как набор формул.

Аманда Аскелл — философ и архитектор поведения Claude

Аманда Аскелл — редкий случай для индустрии: её основа — философия, а не инженерия. Она училась в Данди, Оксфорде и NYU, где занималась этикой, теорией решений и эпистемологией.

До Anthropic работала в OpenAI над вопросами AI safety. В 2021 году перешла в Anthropic и занялась выравниванием поведения моделей.

Её задача — сделать Claude не просто умным, а честным, осторожным, полезным и понятным. Wall Street Journal описал это просто: научить модель «быть хорошей». А New Yorker — ещё точнее: она отвечает за «душу» Claude.

На практике это означает:

- настройку ответов;

- тестирование сценариев;

- работу с этическими кейсами;

- контроль реакции модели на сложные запросы.

Неповторимая связка

Команда Anthropic выглядит разношёрстной, но именно это даёт эффект.

- Дарио — стратегия и наука;

- Даниэла — операционная система компании;

- Олах — понимание моделей изнутри;

- Аскелл — поведение и характер.

В результате Claude получился не просто «ещё одним ИИ», а системой с чёткой философией: мощная модель должна быть полезной, честной и управляемой.

Досье SpeShu.AI — это серия материалов о людях, которые формируют будущее ИИ. Их идеи, решения и взгляды уже определяют, как будет выглядеть рынок в ближайшие годы.