Читайте в Telegram

|

66% руководителей в США говорят, что не стали бы нанимать кандидата без навыков работы с ИИ. А 71% готовы выбрать менее опытного специалиста, если он умеет пользоваться нейросетями, вместо более опытного кандидата без таких навыков. Эти цифры ещё в 2024 году появились в отчётах Microsoft и LinkedIn.

При этом сама OpenAI в исследовании «How people use ChatGPT» признаёт: большинство пользователей используют инструмент неэффективно. А 73% запросов формулируются бытовым языком — так, что модель понимает их слишком буквально и начинает вести себя как глупая жестянка.

Мы изучили исследования в области машинного обучения и собрали инструкцию: как писать промпты так, чтобы получать от нейросетей рабочий результат — и оставаться востребованным на рынке, где ИИ уже стал обязательным навыком.

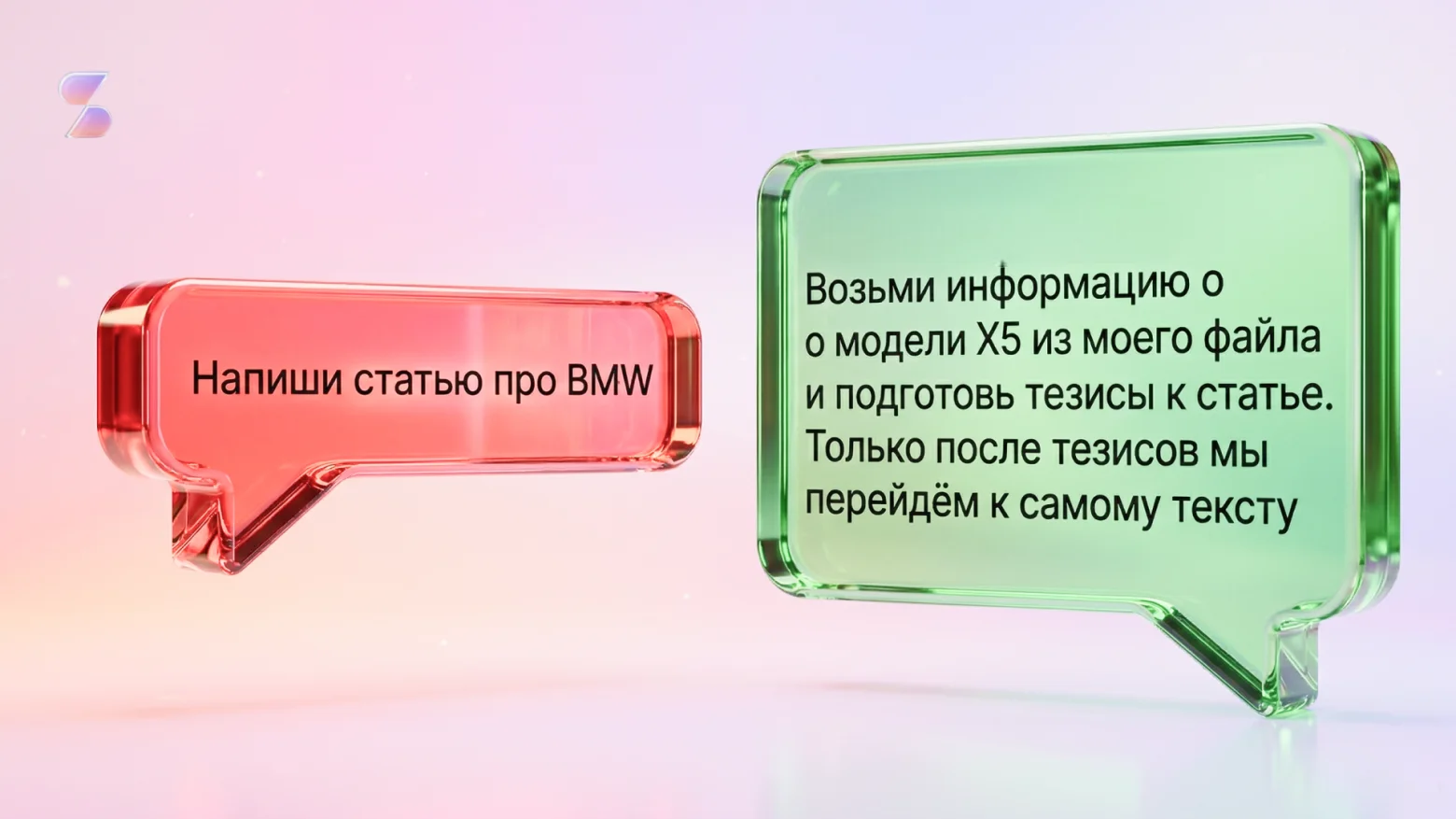

Ошибка №1. Запрос без контекста

- Что происходит: пользователь пишет что-то вроде «Напиши пост в LinkedIn». Но модель не знает, кто автор: директор по логистике, HR, консультант или founder. Она не понимает аудиторию, рабочий контекст, желаемый тон и цель публикации. В итоге LLM почти неизбежно выдаёт усреднённый текст для усреднённого человека — тот самый «AI-стиль», который считывается уже с первых строк.

- Что говорят исследования: в работе The Prompt Report Шульхоффа и соавторов главный вывод шире, чем просто «пишите понятнее». Качество ответа зависит не только от инструкции, но и от контекста, который получает модель: роли, примеров, ограничений, формата, дополнительных данных и in-context examples.

Это отдельно подтверждает исследование Chroma Research Context Rot от июля 2025 года. Авторы протестировали 18 моделей, включая GPT-4.1, Claude 4, Gemini 2.5 и Qwen3, и показали неприятную вещь: модели используют длинный контекст неравномерно, а качество ответа падает не плавно, а рывками — причём по-разному у разных моделей.

Иными словами, длинный промпт сам по себе не гарантирует хороший результат. Иногда он, наоборот, всё портит.

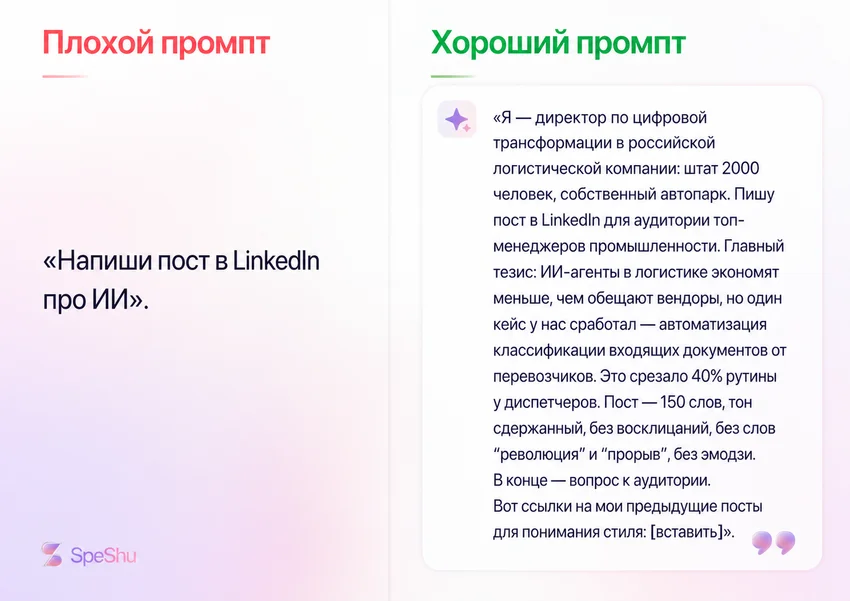

Ошибка №2. «Представь, что ты…» — устаревший ритуал

- Что происходит: люди начинают промпт с фразы «Ты — профессор Гарварда», «Ты — senior-разработчик», «Ты — копирайтер с 20-летним опытом». В 2023 году это было почти обязательным советом из каждого гайда по ChatGPT.

- Что говорят исследования: как объяснял Шульхофф в интервью в 2025 году, ролевой промпт действительно может слегка повлиять на тон и стиль ответа, но почти не влияет на его корректность.

Почему так: современные модели уже пост-тренируются под качественный ответ по умолчанию. В 2023 году модель была ближе к «сырому текстовому предсказателю», и фраза «ты — эксперт» могла заметно сдвинуть распределение в сторону более профессионального текста. В 2025–2026 годах этот эффект стал почти незаметным: модель и так отвечает как эксперт, если ей задать точную задачу.

Что работает лучше: не роль, а перспектива и фокус. Не «ты — финансовый аналитик», а «проанализируй этот портфель с точки зрения толерантности к риску и долгосрочного роста».

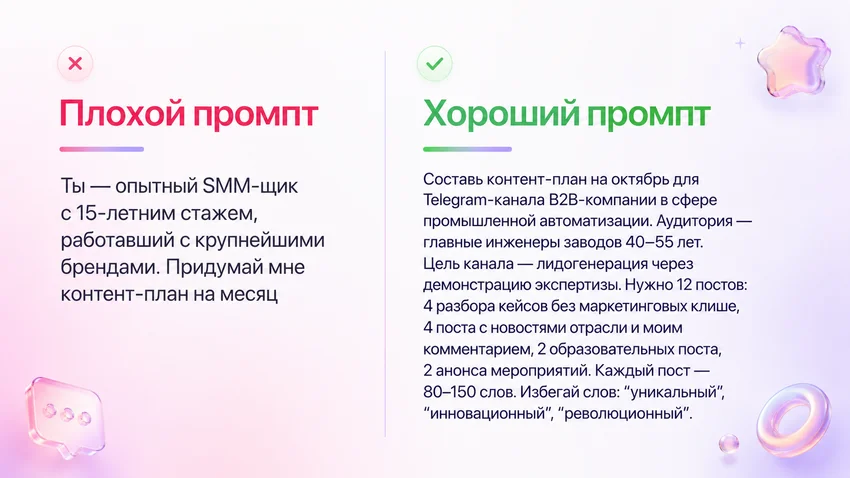

Ошибка №3. «Думай пошагово» на reasoning-модели — уже вред, а не польза

- Что происходит: массовый совет 2023–2024 годов — добавить в промпт «let’s think step by step» или «думай пошагово». Пользователи до сих пор вставляют эту фразу везде, даже в GPT-5 и Claude с включённым режимом рассуждений.

- Что говорят исследования: классическая отправная точка здесь — работа Google «Large Language Models are Zero-Shot Reasoners», опубликованная в мае 2022 года. Именно она превратила фразу «Let’s think step by step» в индустриальный мем: авторы показали, что такая простая добавка может резко улучшать результаты на задачах рассуждения у моделей того поколения. Но это был важный приём именно для того этапа развития LLM, а не вечный закон промптинга.

К середине 2025 года картина стала сложнее. В отчёте Wharton исследователи проверили chain-of-thought на датасете GPQA Diamond — 198 вопросов уровня PhD по биологии, физике и химии, по 25 прогонов на каждое условие.

Для «неризонинговых» моделей прирост действительно был, но умеренный и не всегда стабильный: Gemini 2.0 Flash — +13,5%, Sonnet 3.5 — +11,7%, GPT-4o-mini — +4,4%, причём для последней модели результат оказался статистически незначимым. Для reasoning-моделей выгода почти исчезала: o3-mini и o4-mini прибавляли всего 2,9–3,1%, зато ответы становились на 20–80% медленнее.

Иными словами, просьба «думай пошагово» всё чаще покупает не качество, а задержку.

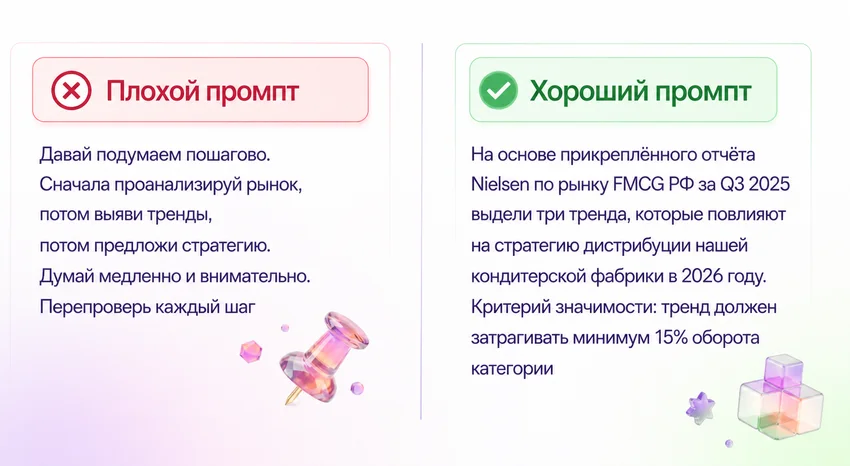

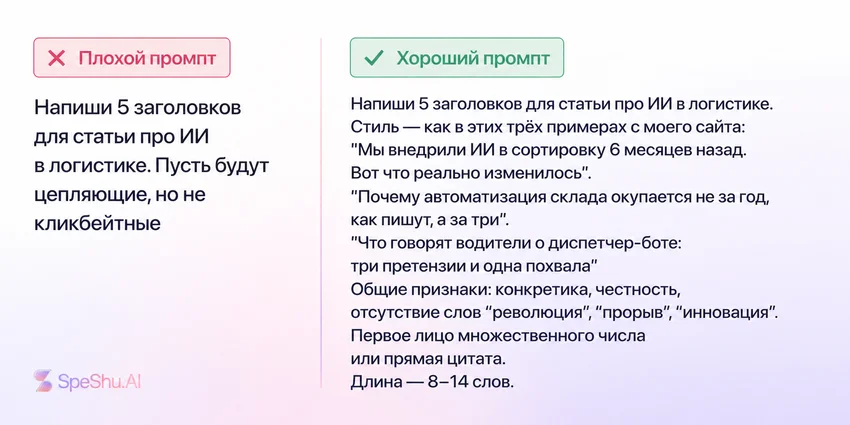

Ошибка №4. Примеры сильнее описаний, но их почти никто не даёт

- Что происходит: человек пытается словами объяснить модели нужный стиль, формат и тон. Модель понимает это приблизительно — и часто уходит в шаблон.

- Что говорят исследования: few-shot prompting — это техника, при которой модели дают несколько коротких примеров в формате «вход → выход». Так она понимает не только задачу, но и способ ответа. Если zero-shot оставляет модели простор для догадок, то 2–5 хороших примеров часто буквально фиксируют траекторию: как классифицировать, какой тон держать, какие поля заполнять и что считать ошибкой.

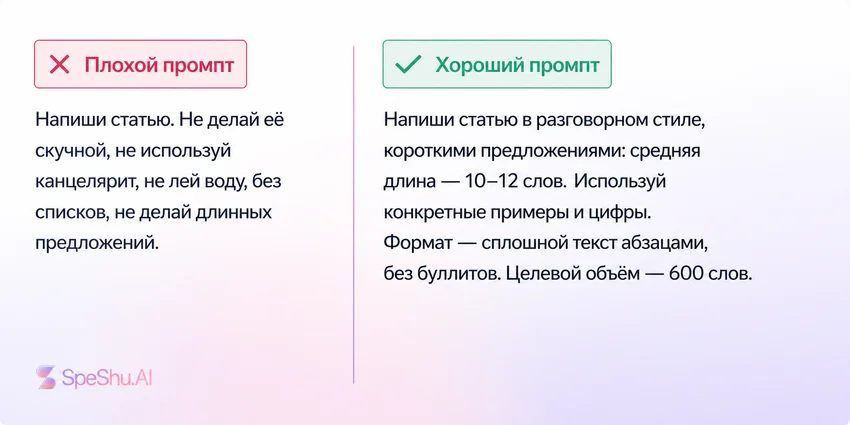

Ошибка №5. «Не пиши…» — слабая формулировка, но с важной оговоркой

- Что происходит: пользователь пишет «только не шаблонно», «не используй слово “уникальный”», «не делай списков». Но результат всё равно часто нарушает запреты.

- Что говорят исследования: для текстовых LLM — ChatGPT, Claude и аналогов — негативные инструкции работают частично, это отмечают составители Prompt Engineering Guide. Формулировка «пиши короткими абзацами» обычно работает лучше, чем «не пиши длинные абзацы».

Но это не абсолютное правило. В технических и безопасностных контекстах негативные инструкции важны и работают лучше: «не включай персональные данные», «не выдумывай источники, если не уверен», «не добавляй факты без подтверждения».

Используйте несколько нейросетей, чтобы получить лучший результат

В профессиональной среде это называют ансамблированием. Вы отправляете примерно одинаковый запрос в разные модели и сравниваете, какая справилась лучше. Такой подход часто используют крупные компании, которые не экономят токены для сотрудников.

Но если вы работаете с нейросетями самостоятельно, бюджет быстро становится проблемой. Подписка на каждую модель стоит около двух тысяч рублей в месяц. Собираете «оркестр» из трёх-четырёх сервисов — и уже платите примерно 8 000 рублей.

Поэтому удобнее использовать агрегаторы вроде SpeShu.AI. Не нужно покупать несколько зарубежных подписок: в одном окне доступны 300+ ИИ-инструментов, без VPN и на русском языке. В итоге вы платите только за использованные токены — без лишних подписок и переплат. Экономьте до 8 000 рублей и используйте нейросети на максимум.